Gekürzte Version

Gerade wir Frauen sind mit Vorurteilen vertraut, sie begleiten uns von der Wiege auf ein ganzes Leben lang. Vorurteile sind der Grund, warum Frauen in Führungspositionen noch immer rar sind. Sie aufzuheben ist ein langsamer Prozess, denn Schubladendenken ist ein wichtiger Teil unserer Evolutionsgeschichte. Selbst in unseren neuesten Technologien sind sie zu finden. Algorithmen, die unser aller Leben zunehmend beeinflussen und bestimmen sind ein großer Stolpersteine auf dem Weg in eine vorurteilsfrei(er)e Zukunft.

WIR ALLE DENKEN IN SCHUBLADEN, weil das automatische Einordnen von Menschen und Situationen einen großen evolutionären Nutzen hat: Es vereinfacht Entscheidungsprozesse und spart uns damit viel Energie. Die größte Gefahr bei der Kategorisierung von Menschen: sie ist immer unfair. Bis vor einigen Jahren haben wir nur zwischen strukturellen und unbewussten Vorurteilen unterschieden. Beide sind Einstellungen und Überzeugungen, die außerhalb unseres Bewusstseins liegen.

Die neue Dimension des Schubladendenkens: Al Bias

Wir leben in einer neuen Ära: im Digital Age, dem Zeitalter der künstlichen Intelligenz (KI oder AI auf Englisch). Alle Social Media Platformen, die meisten Suchmaschinen und auch News-Seiten bauen auf Algorithmen auf. AI-Systeme werden u.a. in den meisten Bilderkennungssystemen großer Unternehmen eingesetzt, wie zB die von Facebook verwendete Bildbeschriftungs-AI, die erkennt, ob es sich um eine Person, ein Tier oder ein Objekt in einem Bild handelt. Sie identifiziert nicht nur die Personen in Bildern, sondern erkennt auch, ob die Person lächelt, Accessoires trägt, steht oder sitzt, und die Gesamtzahl der Personen in einem Gruppenbild. Es gibt also kaum Zweifel an der Leistungsfähigkeit von AI-Systemen. Die durch Deep Learning ermöglichte Datenanalyse und Mustererkennung versetzt AI in die Lage, Krebs im Frühstadium mit größerer Genauigkeit zu diagnostizieren als menschliche Ärzt:innen. AI kann Leben retten, Leben verändern, aber auch – und genau darin liegt das Problem – negativ beeinflussen oder im schlimmsten Fall zerstören. AI bewirkt vor allem eins: sie lässt confirmation bias[1] unkontrolliert und ungebremst wachsen und zeigt uns die Welt so, wie sie uns gefällt. Dadurch werden unsere Vorurteile täglich aufs Neue bestätigt.

[1] Confirmation bias ist die Tendenz, Informationen auf eine Weise zu suchen, zu interpretieren, zu bevorzugen und abzurufen, die die eigenen Überzeugungen oder Werte bestätigt oder unterstützt.

Algorithmische Vorurteile sind eine völlig neue Dimension und wir werden nicht umhinkommen, uns näher mit ihnen auseinandersetzen zu müssen. Künstliche Intelligenz (AI) bestimmt unser aller Leben und wir müssen uns vor allem zwei Fragen stellen:

In vielen großen Unternehmen werden grundlegend wichtige Entscheidungen, wie zB Personalentscheidungen, durch künstliche Intelligenz unterstützt. Zum Beispiel trifft AI eine Vorauswahl, wer zu Vorstellungsgesprächen eingeladen wird. Das Wissen der Algorithmen, die derartige Entscheidungen tragen, speist sich aus mangelhaften, nicht repräsentativen und vergangenen, besonders vorurteilsbehafteten Erfahrungen und hemmt damit eine positive Weiterentwicklung hin zu einer unbiased Zukunft. Weniger abstrakt erklärt: Entscheidet ein Algorithmus darüber, wer für die ausgeschriebene Stelle in einer Führungsposition in die engere Auswahl kommen soll, scheidet er vorweg Menschen mit Migrationshintergrund, Menschen mit Behinderungen und Frauen aus, weil er auf datenbasierte Erfahrungswerte zurückgreift. Für einen Algorithmus sind weiße Männer mittleren Alters eine sichere Wahl. AI-Systeme können ethische und soziale Belange nicht berücksichtigen, wenn sie nicht entsprechend programmiert werden. Und genau darin mangelt es in der männlich dominierten IT-Branche.

Es ist die Schuld des Algorithmus

Künstliche Intelligenz ist nicht böse. Doch die Folgen ihrer Entscheidungen können erheblich sein: schlechtes Kundenservice, geringere Umsätze und Erträge, unfaire und auch illegale Handlungen. Und: sie können sogar zu potenziell gefährlichen Bedingungen führen.

YouTube Tipp: Lo and Behold Clip – The Evolution of AI

https://www.youtube.com/watch?v=_ChGhnbCy6g

In einem Gespräch mit dem Regisseur Werner Herzog über die Gefahren von AI nannte Tesla-Gründer und AI-Skeptiker Elon Musk ein überzeugendes Beispiel: Angenommen, eine künstliche Intelligenz wurde damit beauftragt, den Wert eines Anlageportfolios zu maximieren. Nehmen wir außerdem an, dass die Schöpfer des Systems nicht eindeutig spezifiziert haben, wie dieses Ziel zu erreichen ist. Theoretisch könnte die maschinelle Intelligenz in diesem Fall verstärkt in Rüstungsaktien investieren und so im schlimmsten Fall einen Krieg auslösen.

Aber Achtung! Das Blackbox-Problem

Die größte Gefahr von AI-Systemen ist das sogenannte Blackbox-Problem: wir sind inzwischen unfähig vollständig zu verstehen, warum die Algorithmen hinter AI so funktionieren, wie sie es tun.

Unser Gehirn ist das lebenswichtigste, gleichzeitig aber auch das komplexeste und rätselhafteste unserer Organe. Die künstliche Intelligenz, die den Höhepunkt der menschlichen technologischen Entwicklung darstellt, ist – trotzdem wir sie geschaffen haben – ebenfalls ein Rätsel für uns. Wir wissen zwar eine Menge über unser Gehirn und können mit einiger Sicherheit vorhersagen, wie es auf verschiedene Reize reagiert. Ebenso können wir mit einiger Gewissheit wissen, welche Ergebnisse ein AI-Algorithmus bei bestimmten Eingaben liefern wird. Das Mysterium vor dem Wissenschaftler:innen und Forscher:innen stehen, ist nicht das des Outputs, sondern wie dieser erzeugt wird. Dieses Unwissen über das Innenleben dieser Blackbox der künstlichen Intelligenz ist die größte Hürde in der AI-Entwicklung und wird uns noch lange, wenn nicht für immer, begleiten.

Der breite Einsatz von künstlicher Intelligenz wird eine besondere Herausforderung für die Menschheit sein. Organisationen, die sie nutzen, werden offenlegen müssen, welche menschlichen Entscheidungen hinter dem Design ihrer AI-Systeme stehen, welche ethischen und sozialen Belange sie berücksichtigt haben und wie gut sie die Ergebnisse dieser Systeme auf Spuren von Voreingenommenheit oder Diskriminierung überwacht haben. Wir brauchen Modelle, denen wir auch vertrauen können. Das Erreichen von Transparenz bei AI-Systemen ist von entscheidender Bedeutung. Und wir müssen vor allem eines: Wir müssen Frau der Lage bleiben. Das muss die Devise bleiben.

Was bedeutet das konkret? Was kann ich tun?

- Wir müssen digital literate werden, uns intensiv mit den Technologien auseinandersetzen und sie so gut wie möglich verstehen. Wir dürfen das Feld nicht den Männern überlassen.

- Es ist unser Auftrag und unsere Aufgabe in Unternehmen AI-Modelle zu hinterfragen, wir müssen darauf bestehen, dass Stellenausschreibungen genderneutral verfasst werden und dass Kolleg:innen die Auswahl der AI überprüfen und diverse Daten als Grundlage herangezogen werden.

- Für viele ein zwiespältiges Thema aber unglaublich wichtig: AI lernt von unserer Sprache. Daher ist es umso wichtiger zu gendern. Es ist ein wichtiger Meilenstein in der Aufhebung von Bias.

Filmempfehlung zum Thema

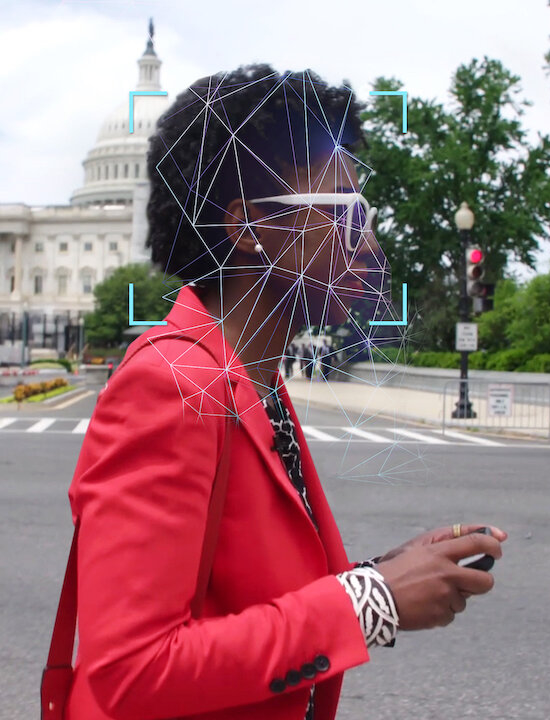

Im Dokumentarfilm Coded Bias folgt die Filmemacherin Shalini Kantayya der Informatikerin Joy Buolamwini vom M.I.T Media Lab und Datenwissenschaftler:innen, Mathematiker:innen und Watchdog-Gruppen auf der ganzen Welt, um die Diskriminierung durch Gesichtserkennungsalgorithmen aufzudecken, die heute in allen Bereichen des täglichen Lebens vorherrschen. Diese Doku kann auf Netflix gesehen werden.

„Wenn man an AI denkt, glaubt man, sie agiert zukunftsorientiert. Aber AI basiert auf Daten, und Daten sind ein Spiegelbild unserer Geschichte.“

Joy Buolamwini